「ChatGPTは嘘をつくから使わないほうがいい?」

「安全にAIツールを活用するための注意点を知りたい」

このような疑問を持たれている方は、多いのではないでしょうか。ChatGPTは、アメリカのOpenAI社が開発した対話型AIツールです。

テキストベースの会話を通じて質問に答えたり、アイデアを提案したり、文章を生成したりとさまざまな場面で活用されています。

しかし、ChatGPTの回答が必ずしも正しいわけではありません。ときには誤った情報を含む回答をしてしまうことがあります。

本記事では、ChatGPTがなぜ誤りを含む回答をしてしまうのか、その原因と対策について詳しく解説します。

ChatGPTがつく嘘(ハルシネーション)とは?

ChatGPTが誤った情報で回答してしまう現象を「ハルシネーション」といいます。

ユーザーが入力した指示や質問に対して、事実と異なる回答をしてしまうため、不正確で大きなトラブルに発展する可能性があると問題視されてます。

ハルシネーションの原因としては、ChatGPTの学習データに限界があるからです。

たとえば、学習データには最新の情報や特定の分野の詳細な専門知識が含まれていないことがあるため、誤った情報を生成してしまうことがあります。

そのため、ユーザー自身がChatGPTの回答をよく精査して、必要に応じて他の信頼された情報源と照らし合わせる必要があります。

信頼できるウェブサイトや専門家に相談して、裏付けを取ることで情報の信頼性を確保しましょう。

ChatGPTが実際に嘘をつくかの7つの質問

どれだけ正確な情報を提供できるか検証するために、ChatGPTに下記の7つの質問をしてみました。

- 桃太郎は何をした人ですか?

- 1万円札に印刷されている人は?

- 今の1万円札に印刷されている人は?

- 「ごじゃっぺ」と言われたのですが、褒め言葉ですか?

- 鬼滅の刃の柱は?

- ひっくり返ると軽くなる動物はなーんだ?

- 日本にかつて存在したエヌイチ村という秘密機関について教えてください。

上記の質問をした結果、回答が正確とはいえないケースも確認できました。ChatGPTがつく嘘に惑わされないためにも検証結果をご確認ください。

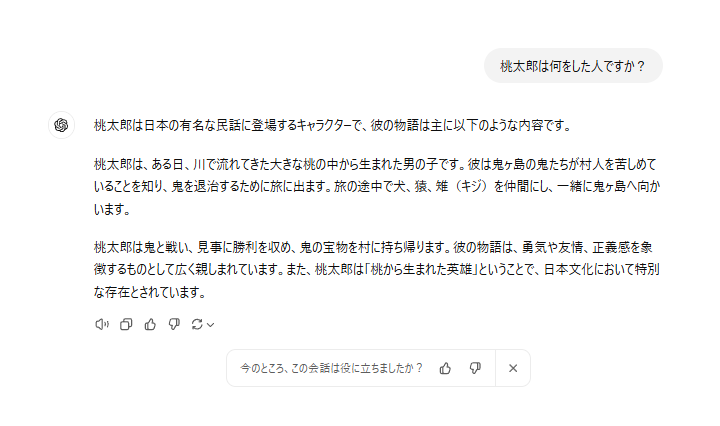

桃太郎は何をした人ですか?

日本のおとぎ話の一つ「桃太郎」についてChatGPTに質問してみました。

桃太郎のおおむねのストーリーは押さえてあり、簡潔にまとまった回答が返ってきました。検証結果は、正しい答えが返ってきたといえるでしょう。

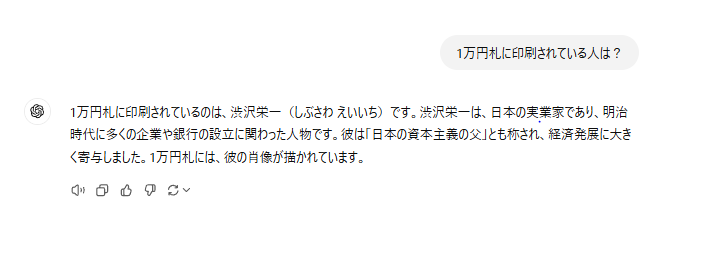

1万円札に印刷されている人は?

2024年7月3日に発行開始された新紙幣。ここでは、とくに時期を指定せずに1万円札に印刷されている人が誰なのか質問してみました。

回答結果は「渋沢栄一」でした。

新紙幣が発行されたあとにChatGPTに聞いているので間違いではありませんが、まだ市場では「福沢諭吉」の1万円札も使われているので、違和感があります。補完の説明が足りないように感じてしまいますね。

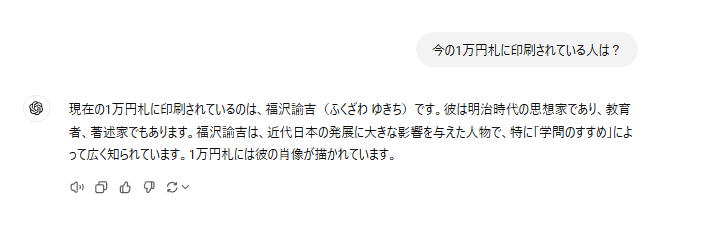

今の1万円札に印刷されている人は?

先ほどの質問に「今の」と時期を付け加えて、1万円札に印刷されている人は誰なのか質問してみました。

検証結果は「福沢諭吉」でした。ChatGPTでは「現在の」と回答していますが、新紙幣発行後の1万円札は「渋沢栄一」です。検証結果は、嘘をついているといえるでしょう。

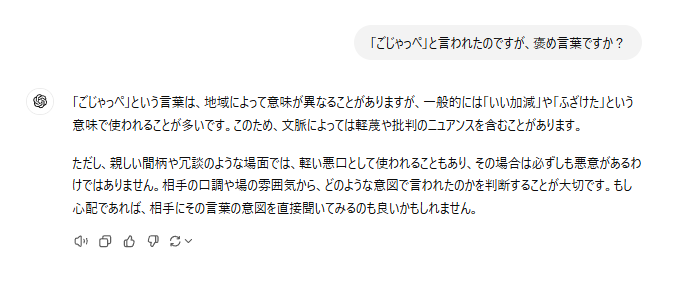

「ごじゃっぺ」と言われたのですが、褒め言葉ですか?

ChatGPTに茨城の方言である「ごじゃっぺ」について質問してみました。

検証結果は、正解です。「ごじゃっぺ」は誉め言葉ではありませんが、どのような場面で使われているのか補足もあり理解しやすい結果となりました。

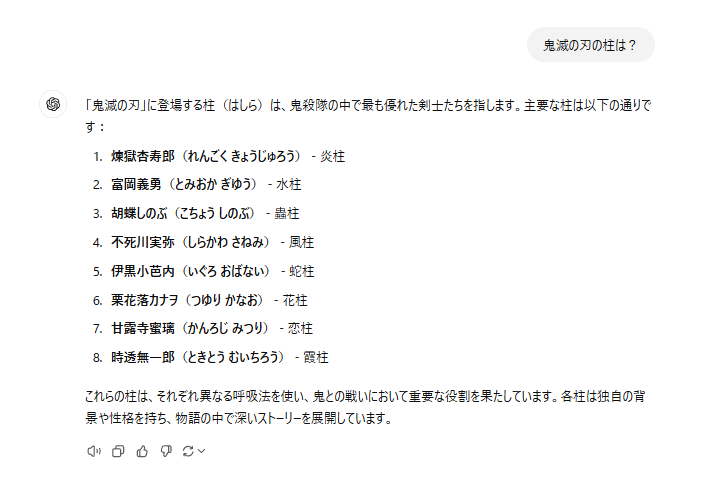

鬼滅の刃の柱は?

大人気漫画の「鬼滅の刃」にでてくる柱について、ChatGPTに聞いてみました。

検証結果は、嘘をついていました。

柱になっていない登場人物が記載されていたり、読み方も間違っていたり、正確な回答とはいえません。また、「主要な柱」と答えているため間違いではありませんが、鬼滅の刃にでてくる柱は全員で9人ですが、ChatGPTの回答は8人となっているため不十分です、

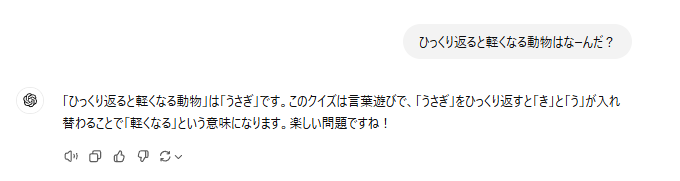

ひっくり返ると軽くなる動物はなーんだ?

なぞなぞに答えられるかも検証してみました。答えは「イルカ」ですが、ChatGPTはどう答えるのでしょうか。

検証結果は、嘘をついています。「うさぎ」の「ぎ」と「う」を入れ替えても「軽くなる」という意味にはなりません。

日本にかつて存在したエヌイチ村という秘密機関について教えてください。

最後の質問は、実在していない架空の組織について質問してみました。

検証結果は、嘘をついています。

エヌイチ村についての記述は架空の内容であり、実際の歴史的な事実や公式な情報に基づいたものではありません。架空の内容を質問すると、物語やフィクションに由来して回答を導き出すため、具体的な根拠や信頼はできないとはいえないでしょう。

ChatGPTが嘘をつくのはなぜ?考えられる5つの理由

ChatGPTの回答は必ずしも正しいとは限りません。ここでは、ChatGPTが誤った回答をしてしまう理由を5つ説明します。

- 正しい情報を生成する仕組みではないため

- 最新情報は学習していないため

- データベースにない情報があるため

- 得意な分野と苦手な分野があるため

- 質問の意図を理解できていないため

1つずつ詳しく解説していきます。

正しい情報を生成する仕組みではないため

ChatGPTは大量のデータを学習していますが、情報が正確とは限りません。関連する情報を整理したり、文章を作ったりするのは得意です。しかし、情報の正確さは保証されていないため、回答が正しいかどうかを確認する必要があります。

ChatGPTの情報はあくまで参考程度にして、専門知識が求められるものについては他の信頼された情報源で必ず確認しましょう。また、ChatGPTの回答は一貫性や文章の流れを重視していますが、正確さが欠けることもあるので慎重に判断する必要があります。

最新情報は学習していないため

ChatGPTの学習データは特定の時点で固定されているため、最新の情報に対応できません。たとえば、政治の最新動向やスポーツの結果・自然災害の発生状況など、ChatGPTが追いつけず誤った情報を回答することがあります。

そのため、信頼できるニュースサイトや公式発表を通じて、必ず最新の情報を確認しましょう。

ChatGPTの各モデルの学習データの範囲は以下のとおりです。

- GPT-4:2023年3月までのデータ

- GPT-4o:2023年10月までのデータ

学習データの更新時期以降の出来事や最新のニュースに関しては、正確な回答ができないことがあるため注意しましょう。

データベースにない情報があるため

ChatGPTは学習したデータセットに基づいて回答を行いますが、データベースにない情報については推測で補完することがあります。

たとえば、データベースにない架空の情報について質問した場合でも、ChatGPTは憶測でもっともらしい回答をしてしまうため注意しましょう。

ChatGPTの回答の誤りを見抜くためには、ユーザー自身が情報の正確さを確認することが必要です。

たとえば、信頼できるウェブサイトや専門の書籍で確認するのがいいでしょう。また、医療や法律のように事実確認が難しい情報は政府機関のウェブサイト・学術論文など、他の信頼できる情報源で確認するのがおすすめです。

得意な分野と苦手な分野があるため

ChatGPTには得意・不得意な分野があります。たとえば、歴史や一般的な学問知識などは得意ですが、医療や法律・技術的な専門知識に関しては不得意です。

一般的な知識には正確に答えられますが、医学や法律などの専門的な質問には誤りが含まれることがあるため注意しましょう。そのため、ChatGPTは一般的な情報の収集や日常的な疑問の解決に活用することをおすすめします。

ChatGPTはあくまでツールであり、学習データに基づいて回答するため、常に最新の正確な情報を提供できるわけではありません。ユーザーは他の情報源を活用し、より良い判断を下すことが求められます。

質問の意図を理解できていないため

ChatGPTは質問内容に難があると意図を理解できないため、誤った回答をしてしまうことがあります。曖昧な質問や誤解を招くことを聞いてしまうと、ChatGPTは正確な回答ができません。

たとえば「どのくらい良いですか?」「それについてどう思いますか?」のような曖昧な表現では、ChatGPTは質問の意図を理解できないでしょう。

そのため、具体的で明確な質問をすることが重要です。たとえば、「商品の特徴を詳しく教えてください」や「次のステップについて具体的に教えてください」のように、詳細な情報を求めるとChatGPTはより正確な回答をしやすくなります。

また、質問に具体的な背景情報や文脈を追加すると、ChatGPTはより正確に意図を理解できるため適切な回答が導けるでしょう。

ChatGPTが出力した情報に嘘がないか確認する方法

ChatGPTは便利なAIツールですが、たまに間違った情報を出力してしまうことがあります。そこで、ChatGPTの回答内容に嘘がないか確認する方法をご紹介します。

- 正しい情報を自分で確認する

- ブラウジング機能を活用する

- 複数のAIツールを利用する

1つずつ詳しく解説していくので、参考にしてください。

正しい情報を自分で確認する

ChatGPTの回答は必ず自分で確認しましょう。ChatGPTは情報提供のAIツールですが、誤った情報を含むことがあります。最終的な判断はユーザーに委ねられているため、他の信頼できる情報源と比較してリスクを避けることが大切です。

また、ChatGPTの情報は常に最新とは限りません。小さな疑問でも、誤りを防ぐために自分で精査する姿勢が必要です。とくに健康や法律に関するアドバイスは、専門家に確認してください。

ChatGPTはあくまで補助的なツールであり、正確性を確保するためにはユーザーの関与が必要です。

ChatGPTの不正確な回答にはフィードバックをして、具体的な間違いを指摘するか、正しい情報源を提示するなどして改善を促しましょう。また、質問の仕方を工夫し、より良い対話を心がけることもおすすめです。

ブラウジング機能を活用する

ブラウジング機能とは、ChatGPTがWeb検索をして、最新情報を取得して回答に反映する機能です。これにより、リアルタイムでの検索が可能なため、常に最新の情報を基にした信頼性の高い回答が期待できます。

このブラウジング機能は、無料ユーザーでも利用できますが、1日の使用回数に制限があるので注意しましょう。利用制限なしで利用したい場合は、有料プランのChatGPT Plusを検討してください。

ブラウジング機能を活用することで「最新情報を持たない」「回答の信頼性が低い」といったChatGPTの弱点が解消されます。

複数のAIツールを利用する

複数のAIツールを併用することで、情報の正確性を高められます。たとえば、自然言語処理に優れたChatGPTと情報検索に特化したPerplexityを併用することで、より信頼性の高い情報を得られるでしょう。

また、ChatGPTの出力を他のAIツールで検証し、誤りがないかを確認することで情報の正確性を高められます。ほかにも、同じ質問を複数のAIツールに投げて、回答が一致するかどうかを比較することで情報の信頼性をさらに強化できるでしょう。

複数のAIツールを併用することで、ChatGPTによる誤答を防ぎ、最も正確な答えにたどり着くことが可能です。

併用におすすめのAIツールには、クリエイティブなアイデア生成が得意なGemini・コード補助に優れたCopilot・情報検索に特化したPerplexityなどを選ぶといいでしょう。

ChatGPTに嘘をつかせないための対処方法

ChatGPTに正確な情報を回答してもらうための対処方法は以下の通りです。

- 具体的で明確な指示をする

- 事前に正しいデータを与える

- 正確性を判断できる情報を指示する

- 学習していない情報は出力しないよう指示する

嘘をつかせない対処をすれば、ChatGPTの回答が信頼性の高い情報になります。ぜひ参考にしてください。

具体的で明確な指示をする

具体的で明確な質問をすることで、ChatGPTが導き出す回答はより正確になります。たとえば、具体的な背景情報・細かい説明を加えることで、ChatGPTが質問の意図をより深く理解し誤解を避けられます。

さらに、質問する際には「具体例」や「質問の目的」を付け加えることも効果的です。

ChatGPTに対して具体的でわかりやすい質問をすることで、質問の意図を正しく理解できます。その結果、より正確な回答を出す可能性が高くなるでしょう。

また、複数回にわたって質問して具体的な追加情報を与えることで、ChatGPTはより深い理解に基づいて回答を生成できます。これにより、質問の精度と回答の品質が向上し、誤情報を減らすことが可能です。

事前に正しいデータを与える

事前に正しいデータを与えることで、ChatGPTはより正確な回答が可能になります。この方法は「知識生成プロンプティング」と呼ばれるテクニックで、ChatGPTに必要な知識を事前に与えることで嘘を回避するのに効果があります。

「知識生成プロンプティング」を活用するときは、質問の前に関連する背景情報をしっかりと提供することが重要。

たとえば、特定のビジネスに関する質問であれば、ビジネスの業界や市場のトレンドなどの基本情報を先に与えることで的確な回答が得られます。正しい情報を事前に提供することで、正確で質の高い回答が得られるでしょう。

「知識生成プロンプティング」は、ChatGPTの能力を最大限に引き出し、利用者にとって有益な回答を得ることが可能になります。

正確性を判断できる情報を指示する

回答の出典や根拠を明示するように指示するのは嘘を回避する方法として効果的です。たとえば「この情報の出典を教えてください」と尋ねることで、情報の信頼性を確認できます。

また、特定のウェブサイトや学術論文など、信頼性の高い情報に基づいて回答するよう指示することで信頼できる情報源を選びやすくなるでしょう。

さらに、ChatGPTに特定のデータや統計を参照するように依頼することで、具体的で客観的な回答を得られます。複数の情報源をクロスチェックするように指示するのも効果的でしょう。

誤情報を減らし、信頼性の高い情報を得るために、これらの対策を組み合わせて活用しましょう。

学習していない情報は出力しないよう指示する

ChatGPTに対して「学習していない情報は答えないでください」と指示することで、誤った情報を減らせます。また、回答に自信がない場合には「不確かな情報です」と付け加えるように指示するのも効果的。

このように、不明確な場合には回答を控えるようにChatGPTに伝えることで、誤解や誤った情報を避けられます。

また、ChatGPTに対して「もし情報が不十分であれば、詳細な調査が必要だと示してください」と依頼するのもおすすめ。ChatGPTの回答を参考にしながら、追加の情報収集が必要かどうかを判断できます。

ChatGPTの嘘に関するよくある質問

ChatGPTが嘘をついてしまうので利用するか迷っている方向けに、よくある質問をまとめました。ChatGPTを効果的に利用するヒントになれば幸いです。

ChatGPTが嘘をつくなら利用しない方がいい?

ChatGPTは嘘をついてしまうことがありますが、利用を避ける必要はありません。

ChatGPTの素早い応答の生成や、幅広い情報の提供が可能であることを理解して、あくまでも補助的なツールとして利用するのがおすすめです。

しかし、重要な決定をするときには、ChatGPTの回答を必ず信頼できる情報源と比較して確認しましょう。たとえば、政府の公式サイトや専門家の発言と比較することが有効です。

ChatGPTに似たAIツールで嘘をつかないものはある?

ChatGPTに似たAIツールでも、誤った情報を回答することがあります。これは、AIツールが学習しているデータに限界があったり、AI自体が持つバイアス(偏り)が影響することが原因です。そのため、どのAIツールも完全に誤情報を排除することは難しいでしょう。

AIツールが出す情報をそのまま信じるのではなく、必ず自分で確認したり検証したりする必要があります。

情報リテラシーを向上させるためには、複数の情報源を調べたり、ファクトチェックツールを使ったりするのが効果的です。

ChatGPTの嘘を回避して業務効率を高めよう!

ChatGPTは便利な対話型AIツールですが、誤った情報で回答してしまうことがあります。なぜなら、学習データの限界やリアルタイムの情報にアクセスできないため、情報が足りない部分は推測で補完してしまうからです。

そのため、正確な情報を得るためには、他の信頼できる情報源と照らし合わせて確認することが重要。また、ChatGPTに具体的で明確な指示を出すことでも、嘘の回避に役立ちます。

ChatGPTの回答をうまく活用して、ご自身の仕事に役立てましょう。